DeepSeek 点燃AI应用革命之火,但安全 “灰犀牛” 正在逼近

图 1 六大威胁围攻大模型的光明顶

> 1.大模型的内容合规风险

> 2.大模型的幻觉问题

> 3.提示词注入攻击与大模型越狱

> 4.数据泄露风险与个人信息保护问题

>5.DeepSeek引发的AI应用革命浪潮,让安全问题变得重要且紧急

“上线即失控” 的魔咒—— 若未在生产环境部署前构建安全护城河,机构将陷入 “上线→出事→整改→停摆” 的恶性循环。

面对大模型应用安全的 “多重暴击”,传统安全防护手段全面失灵

究其根源,传统安全产品基于代码与规则,而大模型风险根植于语言、数据与生成逻辑,需重构防护范式!

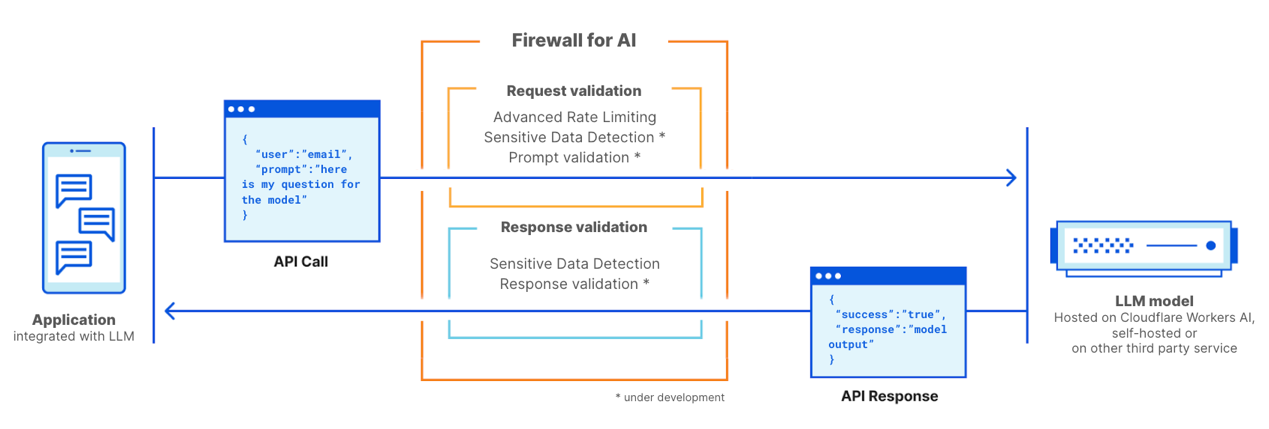

图 2 Cloudflare的人工智能防火墙示意图

国内头部安全厂商在2024年纷纷发布了“大模型安全解决方案”,但真正推向市场的产品还很少。

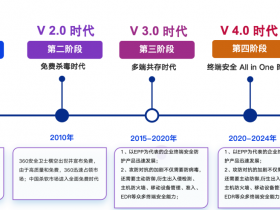

破局:大模型应用防火墙 —— 模型推理的All in One防护

>1.国内首个实现All in One四层防护的大模型应用防火墙

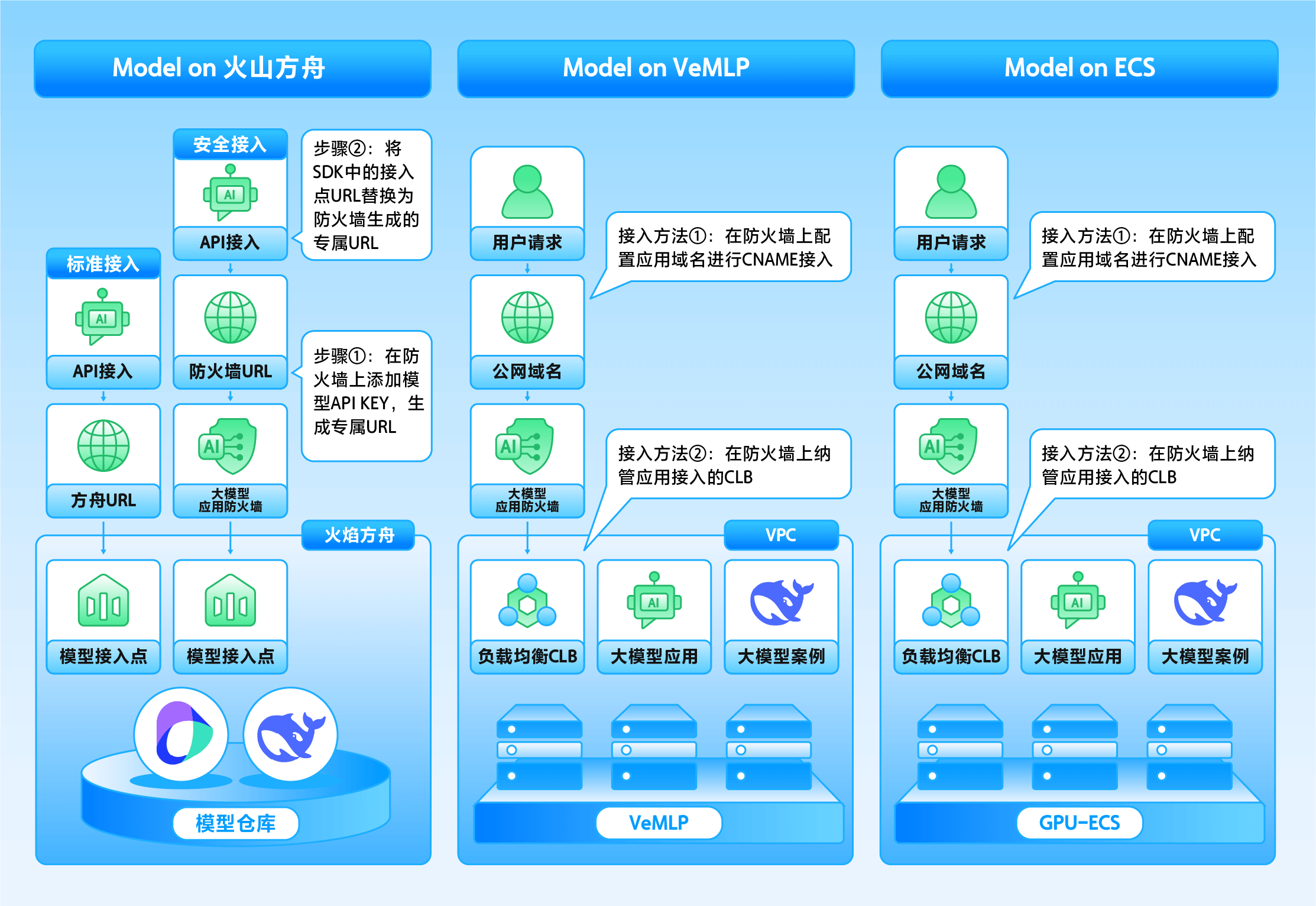

>2.“大模型应用防火墙”的部署方式

图 3 火山引擎“大模型应用防火墙”本地化部署示意图

图 4 火山引擎“大模型应用防火墙”SaaS化部署示意图

大模型应用安全未来发展趋势的展望

数说安全

微信扫一扫

评论